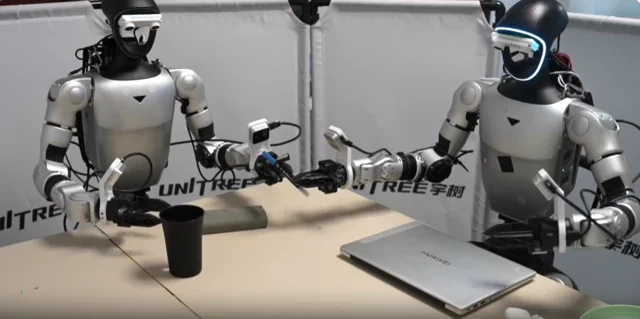

Unitree Robotics, backflip ve dans videolarıyla sosyal medyayı kasıp kavuran şirket, şimdi iş yapabilir robotlara geçiş yapıyor. Şirket, robotlarına “bedensel bir beyin” kazandırmak için tasarlanmış UnifoLM-VLA-0 adlı Görme-Dil-Eylem (VLA) modelini açık kaynak olarak paylaştı. Kısacası, robotlar artık ev işlerinizi yapmaya hazırlanıyor.

Yeni model, Unitree’nin G1 insansı robotunun koreograflanmış gösterilerin çok ötesinde, karmaşık görevleri otonom olarak gerçekleştirmesini sağlıyor. Şu tür işlerden bahsediyoruz: İlaç şişesi açmak, teniz raketi ve topu bir kutuya koyup çantasını kapatmak ve aletleri düzenli bir şekilde tahtaya asmak. Unitree’ye göre model, tek bir politika kullanarak 12 farklı kategori karmaşık manipülasyon görevini güvenilir bir şekilde yerine getirebiliyor — bu, gerçek anlamda çok yönlü bir robot için önemli bir adım.

Bu yeni “bedensel beyin”, Alibaba’nın Qwen ekibinden güçlü bir açık kaynaklı görme-dil modeli olan Qwen2.5-VL-7B üzerine inşa edildi. Unitree, modele gerçek robot verileriyle devam eden ön eğitim vererek fiziksel sağduyu kazandırdı. Tüm proje, kod ve model ağırlıklarıyla birlikte GitHub’da geliştiricilerin kullanımına sunuldu. Bağlantı: UnifoLM-VLA GitHub’da

Neden önemli?

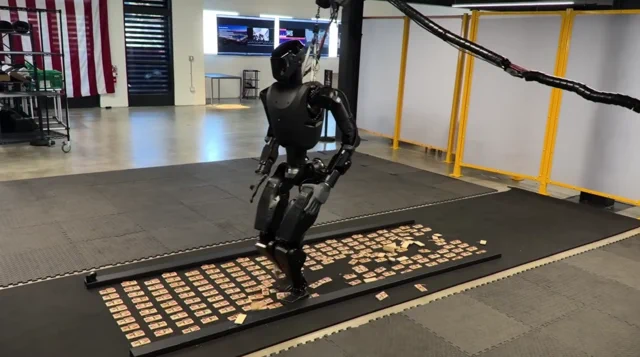

Unitree’nin bu hamlesi iki kritik nedenden dolayı önemli. İlk olarak, yetenekli bir VLA modelini açık kaynak olarak paylaşarak şirket, insansı robotlar için pratik uygulamalar oluşturmak isteyen araştırmacılar ve geliştiriciler için ciddi bir engeli ortadan kaldırıyor. Bu, bazı rakiplerin tercih ettiği kapalı ekosistem yaklaşımına doğrudan bir meydan okuma.