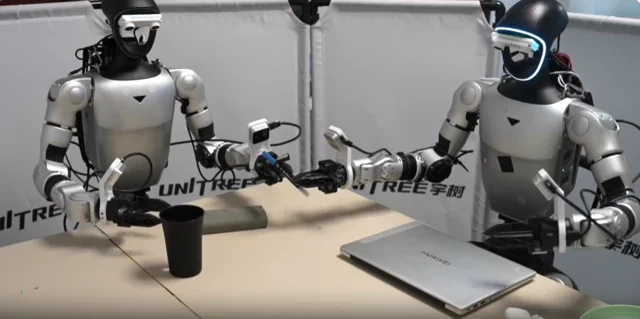

Unitree Robotics, ett företag som blivit känt för virala videor på sina fyrbenta och humanoida robotar som gör backflips och dansnummer, satsar nu på praktiska färdigheter. Företaget har öppnat källkoden för UnifoLM-VLA-0, en Vision-Language-Action-modell (VLA) utformad för att ge sina robotar en “inkarnerad hjärna” för allmän manipulation. Kort sagt: deras robotar lär sig att utföra hushållssysslor.

Den nya modellen gör det möjligt för Unitrees G1-humanoidrobot att autonomt utföra en rad komplexa uppgifter som går långt bortom koreograferade demonstrationer. Vi pratar om att öppna en medicinflaska, packa ner en tenniskets och en boll i ett fodral och dra igenom dragkedjan, samt att metodiskt organisera verktyg på en pennstav. Enligt Unitree kan modellen pålitligt hantera 12 olika kategorier av komplexa manipulationsuppgifter med en enda policy – ett betydande steg mot en verkligt allmän robot.

Denna nya “inkarnerade hjärna” bygger på Qwen2.5-VL-7B, en kraftfull open-source-modell för visuell språkbehandling från Alibabas Qwen-team. Unitree genomförde därefter fortsatt förträning med hjälp av en datamängd med verklig robotdata för att ge modellen fysisk common sense. Hela projektet, inklusive kod och modellvikter, finns nu tillgängligt för utvecklare på GitHub. Hyperlänk: UnifoLM-VLA på GitHub

Varför är detta viktigt?

Unitrees drag är betydelsefullt av två huvudskäl. För det första sänker företaget genom att öppna källkoden för en kapabel VLA-modell drastiskt tröskeln för forskare och utvecklare att skapa praktiska tillämpningar för humanoida robotar. Det är en direkt utmaning mot den stängda ekosystem-approach som vissa konkurrenter föredrar.