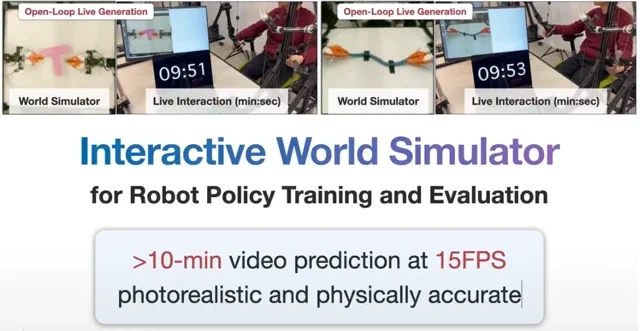

Modelos de mundo na robótica costumam ter a consistência física de um castelo de cartas em simulações longas — basta um sopro para tudo desmoronar. O novo projeto Interactive World Simulator chegou para virar esse jogo, ostentando a capacidade de gerar mais de 10 minutos de previsões de vídeo estáveis e interativas a 15 FPS. E o detalhe que deixa qualquer um de queixo caído: tudo rodando em uma única NVIDIA, Inc. RTX 4090. Sim, você não leu errado. Dez minutos de física complexa fluindo liso em uma GPU de consumo.

Desenvolvido pelo pesquisador Yixuan Wang, este modelo de mundo condicionado por ações não é apenas um vídeo pré-renderizado; é uma simulação totalmente interativa que você pode “pilotar” em tempo real. O mais impressionante? Você pode testar agora mesmo em uma demo direto no navegador, sem precisar passar pelo martírio de configurar bibliotecas Python ou encarar o desespero de um pip install. O modelo lida com uma série de tarefas ricas em contato, desde o manejo intrincado de cabos até a limpeza de pilhas de objetos, tudo gerado puramente no espaço de pixels. Não são imagens capturadas por uma câmera real; são previsões em malha aberta (open-loop) geradas pelo próprio modelo.

Por que isso é um divisor de águas?

Isso não é apenas uma demonstração técnica bacana; é a solução potencial para duas das maiores dores de cabeça da robótica atual. Primeiro, ele permite a geração de dados em escala. Em vez de depender de robôs reais, lentos e caros, para coletar dados de treinamento, os desenvolvedores podem gerar montanhas de dados fisicamente plausíveis dentro do simulador. Segundo, ele possibilita uma avaliação de política fiel, permitindo que pesquisadores testem e refinem o “cérebro” de um robô em um mundo virtual seguro, consistente e infinitamente repetível antes mesmo de encostar em qualquer peça de hardware. Em resumo: o treinamento de robôs torna-se mais barato, mais rápido e com muito menos chances de terminar com um braço mecânico de milhares de dólares abrindo um buraco na parede.