Quando você achava que o ecossistema de IA já estava saturado de “modelos de mundo”, a NVIDIA resolveu apresentar algo que realmente faz a diferença no plano físico. Conheça o DreamZero, um modelo de base para robótica com 14 bilhões de parâmetros capaz de interpretar um simples comando de texto e executar tarefas para as quais nunca foi explicitamente treinado. Batizado de “World Action Model” (WAM), o grande truque aqui é a capacidade de “sonhar” o futuro em pixels de vídeo, permitindo que o robô deduza os controles motores necessários para transformar esse sonho em realidade.

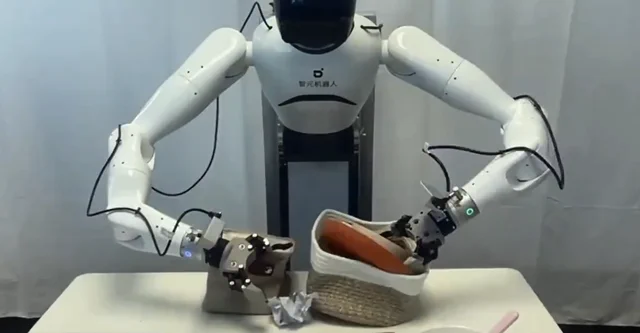

O verdadeiro pulo do gato é a sua adaptabilidade vertiginosa. O DreamZero consegue transferir seu conhecimento para um robô completamente novo e desconhecido com apenas 55 trajetórias de demonstração — o que equivale a cerca de 30 minutos de um humano operando a máquina remotamente. É um salto quântico de eficiência se comparado às centenas de horas de demonstrações exigidas anteriormente. Segundo as pesquisas da NVIDIA, o DreamZero entrega mais que o dobro da performance dos modelos Vision-Language-Action (VLA) de última geração ao generalizar para novas tarefas e ambientes. Você pode conferir o robô em ação, resolvendo desde desamarrar cadarços até apertar mãos, no site oficial do projeto.

O projeto trouxe à tona dois insights fundamentais que desafiam o senso comum do treinamento robótico. Primeiro: para os WAMs, a diversidade dos dados é muito mais crucial do que a repetição infinita da mesma tarefa. Segundo: o velho dilema de transferir conhecimento entre diferentes corpos robóticos (cross-embodiment) encontra sua melhor solução nos pixels. O vídeo, ao que tudo indica, é o tradutor universal, permitindo uma transferência de habilidades impressionante entre robôs e até de humanos para máquinas. O modelo e seus pesos também estão sendo disponibilizados em código aberto via GitHub, permitindo que toda a comunidade de robótica construa sobre este novo alicerce.

Por que isso é importante?

O DreamZero representa uma mudança de paradigma na forma como encaramos o aprendizado de máquinas. Em vez de programar meticulosamente um robô para cada tarefa imaginável — uma estratégia frágil e impossível de escalar — a indústria está migrando para modelos generalistas que aprendem e se adaptam em tempo real. Ao absorver a física do mundo através de vídeos, os WAMs conseguem gerar comportamentos para tarefas inéditas, como desamarrar um sapato, mesmo que essa habilidade específica não estivesse no banco de dados original.

Os próprios pesquisadores, com uma dose saudável de modéstia, comparam este momento à “era GPT-2” da robótica — ainda não é perfeito ou “confiável como um GPT-4”, mas é um passo fundamental e robusto. Ao criar robôs que aprendem com fontes de dados variadas, incluindo vídeos de humanos, e que se adaptam a novos hardwares em questão de minutos, a NVIDIA está derrubando drasticamente as barreiras para o uso de robôs em aplicações complexas do mundo real. O foco deixou de ser ensinar um trabalho específico a um robô; o objetivo agora é dar a ele a capacidade de aprender qualquer trabalho.