A NVIDIA acaba de subir a barra na corrida pela direção autônoma com o anúncio do Alpamayo, revelado neste 5 de janeiro de 2026. Não se trata de apenas mais um modelo de percepção; é um ecossistema aberto completo, desenhado para dar aos veículos o que eles mais precisam e menos têm: a capacidade de raciocinar e explicar suas próprias decisões. O CEO Jensen Huang descreveu o lançamento como o “momento ChatGPT da IA física”, com o objetivo de ensinar os carros a pensar em situações raras ou inéditas.

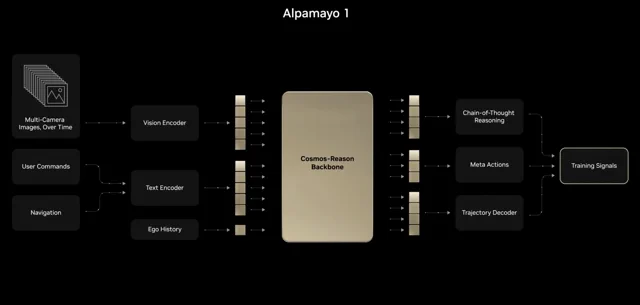

A primeira versão, o Alpamayo 1, é um robusto modelo de visão-linguagem-ação (VLAM). Trocando em miúdos, ele conecta o que o carro enxerga a uma compreensão baseada em linguagem para decidir o que fazer. Isso permite que ele gere “rastros de raciocínio explícito” — ou seja, ele consegue explicar exatamente por que decidiu desviar daquele carrinho de compras perdido no meio da rua. Para treinar essa inteligência, a NVIDIA também está liberando seu Physical AI dataset, uma biblioteca colossal com mais de 300.000 clipes de direção real em mais de 2.500 cidades.

Por que isso é um divisor de águas?

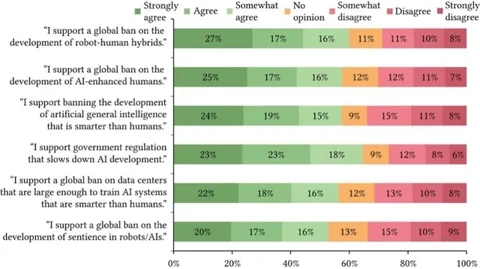

Há anos, a indústria de carros autônomos vive um “salto de fé” com um público compreensivelmente cético. Modelos que operam como “caixas-pretas” indecifráveis não ajudam a construir confiança. Ao apostar em uma IA explicável (XAI), capaz de articular seu processo de tomada de decisão, a NVIDIA está encarando o problema da credibilidade de frente. Essa transição para modelos baseados em raciocínio é um ingrediente crítico — e, francamente, obrigatório — para finalmente superarmos a barreira do Nível 3 e chegarmos à verdadeira direção autônoma de Nível 4, onde o veículo assume o controle na maioria das situações sem precisar de intervenção humana. No fim das contas, não se trata apenas de ver a estrada, mas de realmente entendê-la.