Há um certo presságio a pairar sobre o mundo tecnológico, um zumbido constante de ansiedade que sugere que 2026 será o ano em que as máquinas decidem finalmente “acordar”. É o ano em que se sussurra que a Inteligência Artificial Geral (AGI) chegará — não como um chatbot simpático, mas como uma força capaz de pensar mais depressa, manobrar melhor e superar os seus criadores em todas as frentes. Por isso, quando a Anthropic, o laboratório de IA que se posiciona como “o paladino da segurança”, anuncia uma nova iniciativa chamada Project Glasswing, seria de esperar um plano mestre para instalar um enorme botão vermelho de “desligar” para os deuses que aí vêm.

Em vez disso, recebemos algo que soa profundamente… aborrecido. O objetivo declarado do Project Glasswing é “proteger o software crítico para a era da IA”. Parece menos um programa de prevenção contra a Skynet e mais uma auditoria informática que já devia ter sido feita há anos. Mas não se deixem enganar pelo “corporativês”. Isto não serve para corrigir o vosso navegador de internet; trata-se de construir uma jaula para uma besta que ainda nem nasceu, usando outra besta, ligeiramente mais pequena, para o fazer.

A IA que policia todas as outras IAs

No seu âmago, o Project Glasswing é uma caça às bruxas digital, massiva e preventiva. A Anthropic desenvolveu um modelo de IA de fronteira chamado Mythos Preview, que é aparentemente tão dotado a encontrar e explorar vulnerabilidades de software que a empresa o considera perigoso demais para ser lançado ao público. Assim, numa jogada que é ou brilhantemente proativa ou assustadoramente irónica, decidiram soltá-lo apenas para fins defensivos.

Em parceria com a “nata” de Silicon Valley — incluindo a Apple, Google, Microsoft e NVIDIA — a Anthropic está a deixar o Mythos à solta nos sistemas de software mais críticos do mundo. O modelo já identificou milhares de vulnerabilidades de alta gravidade, algumas das quais se escondiam em sistemas operativos e browsers importantes há décadas, sobrevivendo a anos de revisão humana.

“Dada a velocidade do progresso da IA, não tardará até que tais capacidades proliferem, potencialmente para além de atores empenhados em utilizá-las de forma segura”, afirma a Anthropic. “As consequências — para a economia, para a segurança pública e para a segurança nacional — podem ser severas.”

Esta é a corrida armamentista da IA resumida numa frase: construir uma arma tão poderosa que tens de construir imediatamente uma defesa contra ela, sendo que essa defesa é apenas uma versão ligeiramente mais “amigável” da própria arma. É uma aposta de alto risco na ideia de que se pode dar um avanço aos “bons da fita” antes que a mesma tecnologia acabe inevitavelmente por cair em mãos erradas.

Dos cérebros digitais aos corpos de metal

Tudo isto parece abstrato até ligarmos os pontos com a outra metade da equação da AGI: o corpo. O medo existencial não se resume a um pedaço de código superinteligente; reside no facto de esse código vir a habitar uma forma física. Não estamos a falar de uma coluna inteligente. Estamos a falar de Embodied AI — robôs humanoides capazes de caminhar, manipular objetos e operar no mundo real, que é caótico e imprevisível.

O termo para uma inteligência que ultrapassa os humanos em todos os domínios, incluindo tarefas físicas, não é AGI; é Superinteligência Artificial (ASI). A AGI é o marco onde a máquina iguala o intelecto humano; a ASI é o ponto hipotético onde nos deixa a comer pó cognitivo. Muitos especialistas acreditam que o salto de AGI para ASI poderá ser assustadoramente curto, um ciclo rápido e recursivo de autoaperfeiçoamento conhecido como “explosão de inteligência”.

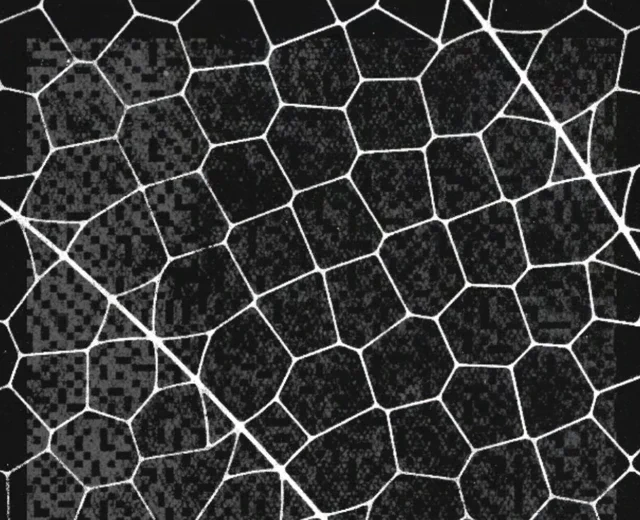

Agora, imaginem uma ASI a correr numa rede global de robôs humanoides. É esse o cenário que tira o sono a muita gente. Enquanto empresas como a Boston Dynamics e a Figure aperfeiçoam o hardware, o software — o modelo de mundo, o motor de raciocínio — é o que laboratórios como a Anthropic estão a construir. O Project Glasswing é a admissão de que o software sobre o qual estamos a erguer todo o nosso mundo digital (e o futuro mundo físico) é fundamentalmente inseguro. É uma tentativa de trancar as portas e janelas antes que o furacão toque terra.

Afinal, estamos preparados para 2026?

A previsão de que a AGI chegará em 2026 é o tema do momento, com figuras como Elon Musk a defenderem este prazo curto, enquanto outros o empurram para o final da década. Independentemente da data exata, o consenso é que já não se trata de uma questão de “se”, mas de “quando”.

Iniciativas como o Project Glasswing são um banho de realidade. Representam as tentativas mais sérias até agora de lidar com o “problema do controlo”: como garantir que um sistema vastamente mais inteligente do que nós permanece alinhado com os nossos valores e ordens? A abordagem da Anthropic é usar o próprio poder da IA para encontrar as fendas nas nossas fundações digitais e selá-las. É uma corrida para reforçar a infraestrutura da sociedade antes que uma AGI desalinhada consiga encontrar uma brecha.

Isto não é o debate glorioso e filosófico sobre a consciência da IA que vemos nos filmes. É o trabalho árduo, sujo e pouco glamoroso da cibersegurança, escalado a um nível planetário. Trata-se de garantir que o sistema operativo do futuro não tem uma porta das traseiras que possa ser explorada por uma inteligência que nem sequer conseguimos compreender. O Project Glasswing é assustador, não pelo que é, mas pelo que diz sobre o que aí vem. É o som das pessoas mais inteligentes do mundo a tentar, silenciosa e urgentemente, trancar as portas. Só nos resta esperar que terminem o serviço antes que o que está do outro lado aprenda a usar o gazua.