W świecie technologii unosi się specyficzny zapach lęku – cichy szum niepokoju sugerujący, że rok 2026 będzie momentem, w którym maszyny ostatecznie „się obudzą”. To właśnie wtedy, według kuluarowych szeptów, ma nadejść era Silnej Sztucznej Inteligencji (AGI). Nie jako przyjazny chatbot, ale jako siła zdolna przechytrzyć, wymanewrować i prześcignąć swoich stwórców. Nic więc dziwnego, że gdy Anthropic – laboratorium AI pozycjonujące się jako to „bezpieczne” i „etyczne” – ogłasza nową inicjatywę pod nazwą Project Glasswing, można by oczekiwać wielkiego planu instalacji czerwonego przycisku „stop” dla nadchodzących cyfrowych bóstw.

Zamiast tego otrzymujemy coś, co brzmi wręcz… nudno. Oficjalnym celem Project Glasswing jest „zabezpieczenie krytycznego oprogramowania w erze AI”. Brzmi to mniej jak program zapobiegania scenariuszowi ze Skynetu, a bardziej jak spóźniony audyt IT. Ale nie dajcie się zwieść korpomowie. Tu nie chodzi o łatanie przeglądarki; chodzi o budowę klatki dla bestii, która jeszcze się nie narodziła, przy użyciu innej, nieco mniejszej bestii.

AI do pilnowania innych AI

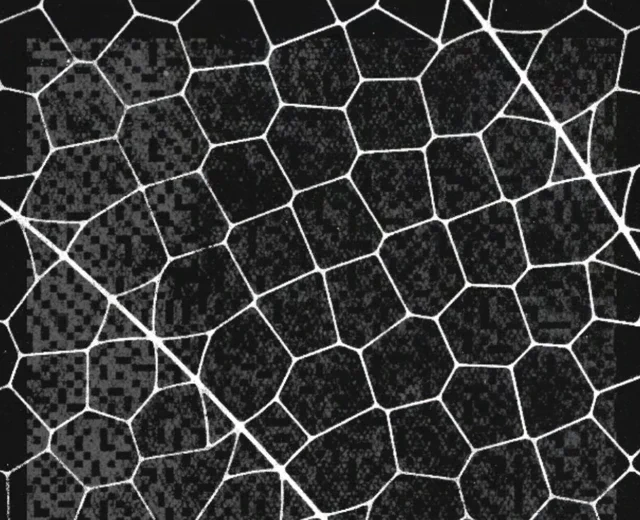

W swojej istocie Project Glasswing to gigantyczne, prewencyjne polowanie na błędy. Anthropic stworzył pionierski model AI o nazwie Mythos Preview, który jest ponoć tak biegły w znajdowaniu i wykorzystywaniu luk w oprogramowaniu, że firma uznała go za zbyt niebezpieczny, by udostępnić go publicznie. Zatem w ruchu, który jest albo genialnie proaktywny, albo przerażająco ironiczny, zaprzęgli go do celów defensywnych.

W partnerstwie z elitą Doliny Krzemowej – w tym z Apple, Google, Microsoft i NVIDIA – Anthropic wypuszcza Mythos na najważniejsze systemy operacyjne świata. Model zdążył już wytropić tysiące krytycznych podatności. Niektóre z nich czaiły się w najpopularniejszych przeglądarkach i systemach od dekad, niewzruszone latami audytów przeprowadzanych przez ludzi.

„Biorąc pod uwagę tempo postępu AI, nie minie dużo czasu, zanim podobne zdolności staną się powszechne, trafiając w ręce podmiotów, które niekoniecznie dbają o bezpieczeństwo” – stwierdza Anthropic. „Konsekwencje dla gospodarki, bezpieczeństwa publicznego i narodowego mogą być katastrofalne”.

Oto wyścig zbrojeń AI w pigułce: budujesz broń tak potężną, że natychmiast musisz stworzyć przeciwko niej tarczę, a ta tarcza to po prostu nieco bardziej ułożona wersja tej samej broni. To ryzykowny zakład o to, że uda się dać „tym dobrym” przewagę, zanim ta sama technologia nieuchronnie wycieknie do sieci.

Od cyfrowych mózgów do fizycznych ciał

Wszystko to wydaje się abstrakcją, dopóki nie połączymy tego z drugą połową równania AGI: ciałem. Egzystencjalny lęk nie dotyczy tylko genialnego kawałka kodu; chodzi o ten kod zamieszkujący fizyczną formę. Nie mówimy tu o inteligentnym głośniku. Mówimy o Embodied AI (ucieleśnionej sztucznej inteligencji) – humanoidalnych robotach, które potrafią chodzić, manipulować przedmiotami i operować w naszym chaotycznym, rzeczywistym świecie.

Termin określający inteligencję przewyższającą ludzi w każdej dziedzinie, w tym w zadaniach fizycznych, to nie AGI, lecz Sztuczna Superinteligencja (ASI). AGI to kamień milowy, w którym maszyna dorównuje ludzkiemu intelektowi; ASI to hipotetyczny punkt, w którym zostawia nas w poznawczym tyle. Wielu ekspertów uważa, że skok z AGI do ASI może być przerażająco krótki – to gwałtowny, rekurencyjny cykl samodoskonalenia zwany „eksplozją inteligencji”.

Teraz wyobraźcie sobie ASI zarządzające globalną siecią humanoidalnych robotów. To scenariusz, który spędza sen z powiek badaczom. Podczas gdy firmy takie jak Boston Dynamics czy Figure dopracowują hardware, laboratoria pokroju Anthropic budują software – model świata i silnik rozumowania. Project Glasswing to przyznanie się do błędu: oprogramowanie, na którym budujemy nasz cyfrowy i przyszły fizyczny świat, jest fundamentalnie dziurawe. To próba zaryglowania włazów, zanim huragan uderzy w brzeg.

Czy jesteśmy gotowi na rok 2026?

Prognoza, że AGI nadejdzie do 2026 roku, to temat rozgrzewający branżę do czerwoności. Postacie takie jak Elon Musk stawiają na krótki termin, inni przesuwają go bliżej końca dekady. Niezależnie od dokładnej daty, panuje konsensus: to już nie jest pytanie „czy”, ale „kiedy”.

Inicjatywy takie jak Project Glasswing to bolesne zderzenie z rzeczywistością. Reprezentują one najpoważniejsze jak dotąd próby zmierzenia się z problemem kontroli (alignment): jak sprawić, by system znacznie inteligentniejszy od nas pozostał wierny naszym wartościom i poleceniom? Strategia Anthropic polega na wykorzystaniu potęgi samej AI do znalezienia pęknięć w naszych cyfrowych fundamentach i ich uszczelnienia. To wyścig o utwardzenie infrastruktury społeczeństwa, zanim nieujarzmione AGI znajdzie lukę, którą będzie mogło wykorzystać.

To nie jest podniosła, filozoficzna debata o świadomości maszyn, jaką znamy z kina. To żmudna, mało efektowna praca nad cyberbezpieczeństwem na skalę planetarną. Chodzi o upewnienie się, że system operacyjny przyszłości nie ma tylnych drzwi (backdoorów), które mogłyby zostać otwarte przez inteligencję, której nie jesteśmy w stanie pojąć. Project Glasswing przeraża nie tym, czym jest, ale tym, co mówi nam o nadchodzącej przyszłości. To dźwięk najmądrzejszych ludzi na świecie, którzy w ciszy i pośpiechu próbują zamknąć drzwi na klucz. Możemy mieć tylko nadzieję, że zdążą, zanim to, co czai się po drugiej stronie, nauczy się posługiwać wytrychem.