AI 업계가 ‘월드 모델(World Model)‘이라는 단어로 포화 상태에 이르렀다고 생각하던 찰나, NVIDIA가 실제 물리 세계에서 제대로 작동하는 ‘진짜 물건’을 들고 나왔습니다. 바로 140억 개의 파라미터를 가진 로봇 파운데이션 모델, DreamZero입니다. 이 모델은 간단한 텍스트 명령만으로 한 번도 학습해 본 적 없는 작업을 수행해냅니다. 이른바 ‘월드 액션 모델(World Action Model, WAM)‘이라 불리는 이 기술의 핵심은 비디오 픽셀을 통해 올바른 미래를 ‘꿈꾸는(Dreaming)’ 능력입니다. 로봇이 상상한 미래를 현실로 만들기 위해 필요한 모터 제어 값을 스스로 찾아내는 방식이죠.

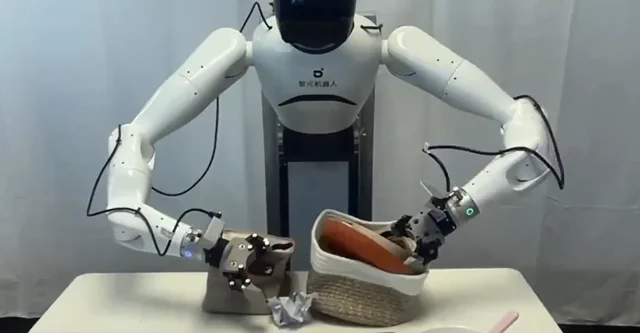

가장 놀라운 점은 압도적인 적응력입니다. DreamZero는 이전에 본 적 없는 새로운 로봇에게 지식을 전수할 때, 단 55번의 시연 데이터만 있으면 충분합니다. 사람이 로봇을 직접 조종하는 시간으로 따지면 고작 30분 남짓입니다. 수백 시간의 시연 데이터가 필요했던 기존 방식과 비교하면 그야말로 비약적인 발전입니다. NVIDIA의 연구에 따르면, DreamZero는 새로운 작업과 환경에 적응하는 능력에서 기존의 최첨단 VLA(Vision-Language-Action) 모델들보다 두 배 이상의 성능을 보여주었습니다. 신발끈 풀기부터 악수하기까지, 로봇이 다양한 과업을 수행하는 모습은 공식 프로젝트 웹사이트에서 확인할 수 있습니다.

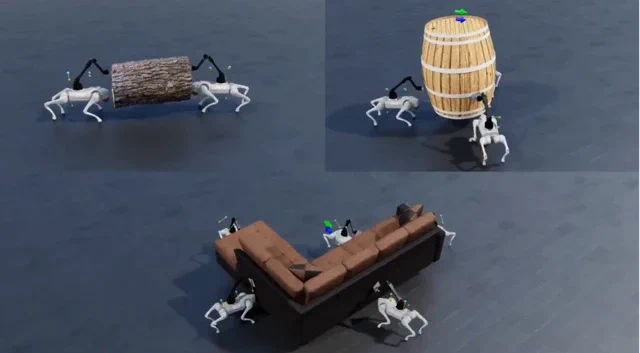

이번 프로젝트는 로봇 학습에 대한 기존의 통념을 깨뜨리는 두 가지 핵심 통찰을 제시했습니다. 첫째, 월드 액션 모델(WAM)에게는 동일한 작업을 무한 반복하는 것보다 데이터의 ‘다양성’이 훨씬 중요하다는 것입니다. 둘째, 서로 다른 로봇 신체 간에 지식을 전달하는 ‘크로스 임바디먼트(Cross-embodiment)’ 문제의 해답은 결국 ‘픽셀’에 있다는 점입니다. 비디오는 로봇과 로봇, 심지어 인간과 로봇 사이의 기술 전수를 가능케 하는 ‘보편적 번역기’ 역할을 합니다. NVIDIA는 이 모델과 가중치(Weights)를 GitHub를 통해 오픈 소스로 공개하여, 로봇 공학 커뮤니티 전체가 이 새로운 토대 위에서 발전할 수 있도록 했습니다.

이것이 왜 중요한가?

DreamZero는 로봇 학습 패러다임의 근본적인 전환을 의미합니다. 가능한 모든 시나리오를 일일이 프로그래밍하는 불가능하고도 취약한 전략 대신, 업계는 스스로 배우고 적응하는 ‘제너럴리스트(Generalist)’ 모델로 나아가고 있습니다. 비디오를 통해 세상의 물리 법칙을 학습한 WAM은 신발끈 풀기처럼 학습 데이터에 없던 생소한 작업이라도 물리적 흐름을 예측해 행동을 생성해낼 수 있습니다.

연구진은 현재의 단계를 로봇 공학의 ‘GPT-2 시대’라고 겸손하게 표현합니다. 아직 완벽하거나 GPT-3만큼의 신뢰성을 갖춘 것은 아니지만, 매우 강력한 기초를 닦았다는 뜻입니다. 인간의 활동 영상 등 다양한 데이터 소스에서 학습하고, 단 몇 분 만에 새로운 하드웨어에 적응하는 로봇을 구현함으로써 NVIDIA는 복잡한 현실 세계에 로봇을 투입하기 위한 진입 장벽을 획기적으로 낮추고 있습니다. 이제 로봇에게 특정 ‘업무’를 가르치는 시대를 지나, ‘어떤 업무든 배울 수 있는 능력’을 부여하는 시대로 접어든 것입니다.