TRANSLATE START

title: “FunctionGemma: 구글의 주머니 속 AI, 당신의 폰에 꽂히다” # Maximum 65 characters for SEO description: “구글이 2억 7천만 개 매개변수의 초소형 AI, FunctionGemma를 공개했습니다. 클라우드 없이 스마트폰에서 음성 명령을 바로 실행하는 이 AI는 프라이버시와 속도를 모두 잡았습니다.” # Meta description: 25-160 characters slug: “functiongemma-googles-tiny-ai-for-your-phone-unplugged” categories: [“AI”, “Mobile”, “Software”] tags: [“functiongemma”, “google”, “on-device-ai”, “small-language-models”, “privacy”, “mobile-technology”]

TRANSLATE END

Technical

draft: false # false by default date: 2025-12-21 authors: [“Robot King”] featuredImage: “/images/shared/magazine/2025-12-21-image001-a514ee65.jpg” featured: true # featured by default

Source Attribution - we do not use this, place links into the content

source: "" # Original source URL (optional)

sourceAuthor: "" # Original author/creator (optional)

Translation metadata

translationKey: “a514ee65-86d0-470e-acda-cc68e35760af” sourceLanguage: “en-us” # Original content language translationStatus: “source” lastTranslated: 2025-12-21T18:51:07+00:00

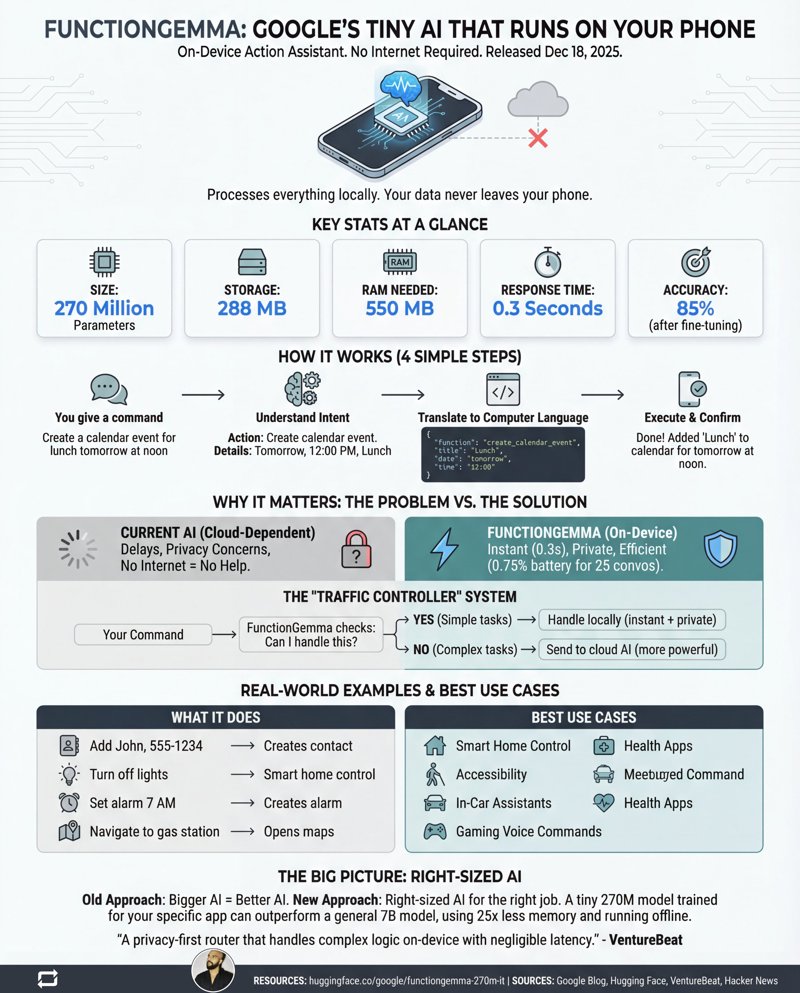

AI 기업들이 가장 거대한 디지털 뇌를 짓기 위해 마치 잔혹한 건축 경쟁이라도 벌이는 듯한 세상에서, 구글은 정말 웃기는 짓을 해냈습니다: 주머니에 쏙 들어가는 녀석을 내놓은 거죠. 2025년 12월 18일, 마치 소프트웨어 패치 노트라도 되는 양, 요란법석 없이 구글은 조용히 FunctionGemma를 세상에 내놓았습니다. 이 녀석은 북극 데이터 센터에 사는 수조 개의 매개변수를 가진 거대 모델이 아닙니다. 2억 7천만 개의 매개변수를 가진 초소형 모델로, 단 한 가지를 기막히게 잘하도록 설계되었습니다: 바로 당신의 폰에서 인터넷 없이 모든 일을 처리하는 거죠.

업계 전체가 ‘크면 클수록 좋다’고 외치는 동안, FunctionGemma는 신선한 현실주의 한 방을 선사합니다. 이는 Gemma 3 270M 모델의 특수 버전으로, ‘함수 호출(function calling)‘을 위해 명시적으로 튜닝되었습니다. 결코 화려하진 않지만, 당신의 음성 명령을 기기가 실제로 실행할 수 있는 코드로 바꾸는 중요한 작업이죠. 이걸 대화하는 철학자라기보다는, 당신 폰 기능의 초효율 만능 리모컨이라고 생각해보세요. 간단한 작업에서는 클라우드 연결을 끊어버려, 지연 시간, 개인 정보 보호 문제, 그리고 신호 없이는 무용지물이 될지도 모른다는 존재론적 공포까지 한 방에 날려버리는 겁니다.

작은 모델, 거대한 파급력

숫자 이야기를 좀 해볼까요? 요즘 AI 판에서는 거의 코미디 수준이거든요. FunctionGemma는 초중량급 선수들 사이에서 깃털급 챔피언입니다.

- 매개변수: 2억 7천만 개 (참고로 GPT-4는 수천 배 더 크다고 추정됩니다)

- 크기: 모델 용량은 약 288 MB로, 디지털 보석을 팔아먹으려는 수많은 모바일 게임보다도 작습니다.

- RAM 사용량: 실행하는 데 겨우 550 MB의 RAM을 홀짝거립니다.

- 응답 시간: 서버 팜까지 왕복하는 건 잊으세요. 기기 내 처리 시간은 0.3초에 불과합니다.

- 개인 정보 보호: 100%. “내 슬픈 책상 점심을 위한 타이머를 맞춰줘"라는 당신의 명령은 절대 당신의 기기를 떠나지 않습니다.

이건 단순히 거대 언어 모델을 축소하는 이야기가 아닙니다. 완전히 다른 철학이죠. FunctionGemma는 당신의 자연어와 폰 소프트웨어 사이의 다리 역할을 하도록 설계되었습니다. 연락처를 만들거나, 손전등을 켜고 끄거나, 캘린더 일정을 즉시 설정하는 로컬 에이전트 역할을 하는 거죠.

‘교통 정리관’의 묘수

구글은 이 2억 7천만 개 매개변수의 꼬맹이가 자신들의 클라우드 기반 거인들을 대체할 거라고 주장하는 게 아닙니다. 대신, 이 녀석을 지능형 ‘교통 정리관’으로 포지셔닝하고 있습니다. 아이디어는 기가 막히게 간단합니다: 명령이 간단하면(‘불 꺼줘’), FunctionGemma가 기기 내에서 즉각적이고 사적인 응답을 처리합니다. 만약 더 복잡한 질문을 하면(‘펠로폰네소스 전쟁의 역사는 뭐고, 그걸 뱃노래로 요약해줄 수 있어?’), 이 녀석은 자신의 한계를 알고 Gemma 3 27B 같은 더 강력한 클라우드 기반 모델로 쿼리를 영리하게 라우팅합니다.

이 하이브리드 접근 방식은 두 마리 토끼를 다 잡게 해줍니다: 행성 규모의 추론이 필요 없는 90%의 작업에는 엣지 컴퓨팅의 속도와 개인 정보 보호를, 정말 필요할 때는 클라우드의 순수한 힘을 제공하는 거죠. 단순히 강력한 것을 넘어, 효율적으로 설계된 시스템입니다.

미세 조정이 비장의 무기

개봉 직후의 FunctionGemma는 완벽하지 않습니다. 구글 자체 ‘모바일 액션’ 평가에서, 기본 정확도는 고작 58%로 지극히 평범했습니다. 하지만 여기서 핵심이 있습니다: 이 모델은 그냥 가져다 쓰라고 만든 게 아닙니다. FunctionGemma는 기반이자, 고도로 훈련 가능한 찰흙 한 덩어리인 셈이죠.

특정 데이터셋, 이 경우엔 일반적인 폰 명령 목록으로 미세 조정을 거치자, 정확도는 85%까지 치솟았습니다. 이러한 도약이 바로 핵심입니다. 구글은 개발자들에게, 당신의 특정 앱 기능에 맞춰 훈련된 작고 특화된 모델이 방대한 범용 모델보다 훨씬 적은 리소스로 더 나은 성능을 낼 수 있다고 말하는 겁니다. 이는 모든 것을 다 잘하는 만능 재주꾼이 아니라, 각자의 좁은 영역에서 전문가인 맞춤형 AI 에이전트 시대로의 전환을 의미합니다.

물론 한계도 있습니다. 이 모델은 현재 여러 단계를 연결하는 데 어려움을 겪고, 간접적인 요청에는 종종 혼란스러워합니다. 85%의 정확도는 여전히 15%는 틀린다는 의미인데, 단순히 연락처 하나 추가하려다 짜증이 폭발할 수도 있겠죠. 하지만 개념 증명(proof of concept)으로서, 이는 강력한 선언입니다.

미래는 주머니 속에, 클라우드만이 아니다

FunctionGemma는 단순히 새로운 모델 그 이상입니다. 이는 AI 군비 경쟁이 새로운 국면에 접어들었음을 알리는 신호탄이죠. 점점 더 거대한 ‘신적 모델’을 구축하려는 집착은, 적절한 작업에 적절한 크기의 AI를 배치하는 더 미묘한 전략으로 대체되고 있습니다. 개발자들에게는 클라우드에 대한 끊임없이 비싼 탯줄에 의존하지 않고도, 더 스마트하고 빠르며 사적인 앱을 구축할 수 있는 문을 열어줍니다.

우리에게는 주머니 속 AI 비서가 훨씬 더 반응적이고 덜 소름 끼치게 될 것이라는 의미입니다. AI의 미래는 서버 팜에 있는 거대한 두뇌 하나만이 아닙니다. 우리가 필요로 하는 바로 그곳에서 효율적으로 작동하는 수백만 개의 작고 특화된 두뇌들입니다. 그리고 그 첫 번째 주자 중 하나가 방금 당신의 폰으로 이사 온 것 같군요.