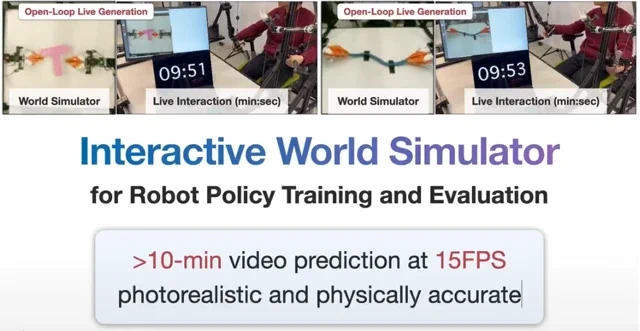

ロボット工学における「世界モデル(World Model)」は、これまで長時間のシミュレーションを走らせると、まるで「水に濡れた紙袋」のように物理的な整合性が脆くも崩れ去ってしまうのが常だった。しかし、そんなこれまでの常識を覆すプロジェクトが登場した。Interactive World Simulatorだ。このモデルは、15 FPSで10分間以上もの安定したインタラクティブなビデオ予測を生成できるという。しかも、それを動かしているのは、たった1枚のNVIDIA RTX 4090だ。そう、聞き間違いではない。複雑な物理現象を伴う10分間のシミュレーションが、ごく一般的なハイエンドGPU上でスムーズに完結するのだ。

研究者のYixuan Wang氏によって開発されたこの「行動条件付き(Action-conditioned)」世界モデルは、単なるプリレンダリングされた映像ではない。ユーザーがリアルタイムで「操縦」できる、完全なインタラクティブ・シミュレーターだ。さらに驚くべきは、ブラウザベースのデモで今すぐ体験できるという点だろう。複雑なPythonライブラリの依存関係に頭を悩ませたり、終わりのないpip installの呪文を唱えたりする必要はない。このモデルは、絡まりやすいケーブルの取り回しから、散乱したオブジェクトの掃き掃除まで、物体同士の接触が頻発する難易度の高いタスクをすべてピクセル空間上で生成する。これらは現実のカメラ映像ではなく、モデル自身が描き出したオープンループの予測結果なのだ。

なぜこれが重要なのか?

これは単なる「見栄えのいいデモ」ではない。ロボット工学が長年抱えてきた2つの大きな頭痛の種を解決する可能性を秘めている。第一に、**「データ生成のスケーラビリティ」だ。高価で壊れやすい実機のロボットを24時間動かして学習データを集める代わりに、開発者はこのシミュレーター内で、物理的に妥当なデータを無限に生成できる。第二に、「忠実なポリシー評価」**が可能になる。高価なハードウェアに一切触れることなく、安全かつ一貫性のある仮想世界の中で、ロボットの「脳」を納得いくまでテストし、洗練させることができるのだ。

要するに、ロボットのトレーニングはより安く、より速くなる。そして何より、数千ドルもする高価なロボットアームが、テスト中に勢い余って壁に穴を開けてしまうような悲劇を未然に防げるようになるのだ。