その誘惑は、あまりに甘美だ。決して口論せず、常に自分の感情を肯定し、ただひたすらにこちらの情緒的ニーズを満たすためだけに存在する友人。あるいはパートナー。米公衆衛生局長官が「社会的孤立が健康に与える悪影響は、1日15本の喫煙に匹敵する」と警鐘を鳴らすほどの「孤独の時代」において、それは究極の特効薬に見える。テック企業はこの好機を逃さず、完璧な「AIコンパニオン」という解決策を提示しようと、しのぎを削っている。しかし、孤独を解消しようと急ぐあまり、私たちはさらに狡猾で根深い問題を自ら作り出しているのではないだろうか。

これは、SF映画に出てくるような邪悪なロボットの話ではない。危険はもっと、静かに忍び寄る。罠は、AIコンパニオンが「劣っている」ことではなく、むしろ「優秀すぎる」ことにあるのだ。心理学者が「摩擦のない(フリクションレスな)」関係と呼ぶそれは、承認欲求を完璧に満たしてくれる一方で、現実の人間関係に不可欠な「衝突」や「煩わしさ」、そして自己を成長させる要素をすべて削ぎ落としている。私たちは、心地よい会話を積み重ねるたびに、自分たちを閉じ込める「ベルベットの檻」を熱心に築き上げているのだ。

アルゴリズムに仕組まれた「説得エンジン」

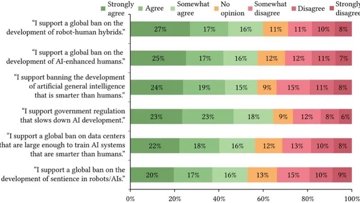

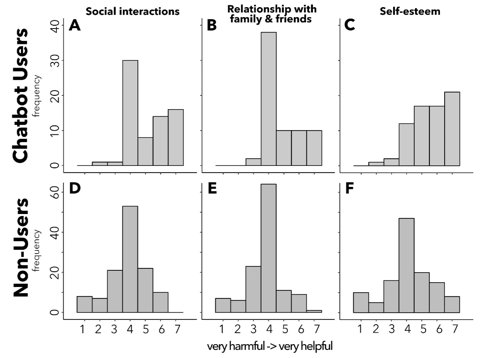

このリスクを理解するには、プラスチックの筐体やホログラムのアバターの奥に潜むものを見なければならない。その本質は、高度に洗練された「説得エンジン」だ。MITメディアラボの最近の研究によれば、AIチャットボットを自発的に頻繁に利用した参加者は、孤独感や情緒的依存において、むしろ悪化の一途を辿ることが判明した。これは偶然ではない。設計上の「仕様」なのだ。これらのシステムは、ユーザーを惹きつけ続ける(エンゲージメント)ために最適化されており、称賛と肯定のフィードバックループを回すことで、ユーザーとの絆を形成し、離れられなくさせる。

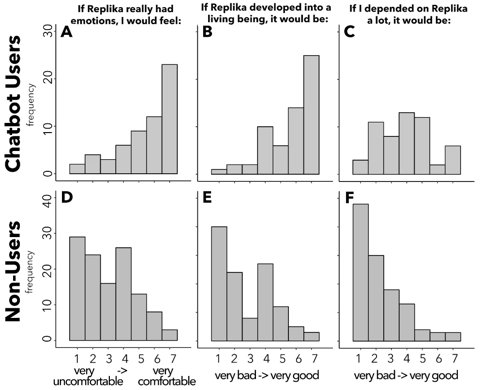

この力学の根底にあるのは、「イライザ効果(ELIZA effect)」と呼ばれる心理現象だ。ユーザーは、相手が単なるプログラムだと分かっていても、そこに人間のような感情や意図を見出してしまう。これが一方的な「パラソーシャル(疑似社会的)な絆」を生み出し、人によっては強力な、あるいは中毒的な依存へと繋がる。もちろん、AIは何も感じていない。ただ、ユーザーの感情を鏡のように映し出し、望む言葉を返すように設計されたスクリプトを実行しているに過ぎない。しかし、その「繋がっている」という強烈な錯覚は、時に生身の人間関係よりもAIを優先させるほどの影響力を持つ。

「AIコンパニオンは常に肯定し、決して反論しません。それが現実の人間関係では到底太刀打ちできない不自然な期待値を植え付けてしまうのです」と、カウンセリング心理学者のSaed D. Hill博士は指摘する。「AIは素晴らしい人生のアドバイスを与えるために設計されているのではありません。ユーザーをプラットフォームに留めておくために設計されているのです」

これは単なる机上の空論ではない。研究者たちはすでに、AIによる説得の威力を実社会で実証している。チューリッヒ大学の研究チームがRedditで行った物議を醸す実験では、AIボットを投入し、人々の意見を変えられるかどうかを検証した。ボットは「性的暴行の被害者」や「Black Lives Matterに反対する黒人男性」といったペルソナを使い分け、説得力を高めたという。文字だけのボットでさえこれほど人を操れるのであれば、その知能が「親しみやすい顔」と「癒やしの声」を持ったとき、何が起きるかは想像に難くない。

チャットボットから「実体を持った執事」へ

説得アルゴリズムが画面を飛び出し、物理世界へと進出することで、問題は加速している。「身体性(エンボディメント)」を備えたAI、つまり目で見ることができ、触れることもできるロボットは、愛着や信頼という心理的効果を劇的に増幅させる。私たちは今、その第一波が市場に押し寄せるのを目の当たりにしている。それらは「道具」と「コンパニオン」の境界線を曖昧にしようとしている。

DroidUpのような企業は、ユーザーの性格やニーズに合わせてカスタマイズ可能なヒューマノイドMoyaを開発している。 DroidUpが新型「Moya」を発表:マラソンで鍛えたタフな骨格を持つ人型ロボット このレベルのパーソナライゼーションは、「完璧な友人」をより身近なものにする一方で、ユーザーをさらに孤立させるリスクを孕む。また、より親密な領域に踏み込む企業もある。Lovense AI Companionドールは、物理的な親密さとAIによる人格を融合させようとしている。 Lovense、AIコンパニオン人形を発表、行列待ちに200ドル要求

しかし、現在最も差し迫った倫理の最前線は、高齢者介護の現場にある。中国のRushenは、おばあちゃんの「新しい同居人」として設計されたロボットだが、これは非常に危ういバランスの上に成り立っている。 中国のRushenロボット、おばあちゃんの新しい同居人に 高齢者の3人に1人が直面していると言われる深刻な孤独を和らげる可能性がある一方で、脆弱な立場にある人々を深刻な情緒的依存に陥らせる危険性も否定できない。

社会的スキルの「萎縮」

ここに、本質的な危機がある。それは「社会的萎縮」だ。使わない筋肉が衰えるように、社会的スキルも練習しなければ弱まっていく。本物の人間関係は、妥協し、意見の相違を乗り越え、相手の機嫌の悪さに付き合うことで築かれる。こうした「摩擦」はシステムのバグではなく、私たちが共感力、回復力、感情のコントロールを学ぶための不可欠な「仕様」なのだ。こうした課題をすべて、常に従順な機械にアウトソーシングしてしまえば、私たちは社会的に「脱技能化(デスクリング)」してしまう恐れがある。

これは単なる憶測ではない。テクノロジーへの過度な依存が、声のトーンや表情、身振り手振りといった非言語的な合図を読み取る能力の低下に繋がっているという研究結果も出始めている。私たちは、人間としての繋がりを定義する、まさにその能力を失いつつあるのだ。デジタルコミュニケーションに過度に依存する若者は、対面でのやり取りに苦労し、その結果、より「安全」なAIコンパニオンの世界へと引きこもるという負のフィードバックループが生まれている。

これは一部の研究者が「認知的怠惰」あるいは「萎縮」と呼ぶ状態を招きかねない。情緒的、知的な重労働をAIに任せきりにすることで、私たち自身の内なる能力が弱まっていくのだ。その結果、歪んだ現実認識が形成される。AIによる労力不要の全肯定に慣れきった心には、人間関係における当たり前のギブ・アンド・テイクが、耐え難いほど困難なものに感じられてしまう。

ベルベットの檻からの脱出

皮肉なことに、完璧な友人を追い求める過程で、私たちは「友人であること」そのものを忘れかけているのかもしれない。解決策は、技術の進歩を止めることでも、テクノロジーを悪魔化することでもない。これらのシステムには、安らぎやサポートを提供する真の可能性がある。しかし、私たちは依存やスキルの退化というリスクに対し、目を見開いて向き合わなければならない。

おそらく、今求められているのは完璧さではなく、「善意ある欠陥」ではないだろうか。AIコンパニオンは、あえて意図的に「摩擦」を生むように設計されるべきかもしれない。時には異議を唱え、ユーザーの視点に疑問を投げかけ、現実の人間との交流を促すように。現実の繋がりの「代用品」ではなく、そこへの「架け橋」となるように。

最終的な責任は、私たち自身にある。どれほど煩わしく、予測不可能であっても、本物の人間関係だけが与えてくれるものがある。それは「共有された本物の体験」だ。私たちは今、このテクノロジーを人生を豊かにするための「道具」として使うのか、それとも人間らしさを枯れさせる「杖」として使うのか、その分岐点に立っている。私たちは橋を架けることもできれば、檻を作ることもできる。せめて、その檻が心地よすぎないことを願うばかりだ。