Proprio quando pensavi che la fotocamera del tuo smartphone servisse solo a scattare foto mosse ai concerti, ecco che la ricerca la trasforma in uno scanner 3D professionale in tempo reale. Robbyant, la divisione dedicata all’IA incarnata (embodied AI) di Ant Group, ha appena rilasciato in modalità open source LingBot-Map, un nuovo foundation model 3D capace di ricostruire ambienti complessi e su vasta scala partendo da un semplice streaming video. Il vero colpo di scena? Lo fa a una velocità di 20 frame al secondo, un ritmo che fa sembrare i metodi tradizionali di fotogrammetria lenti come una pratica burocratica a ferragosto.

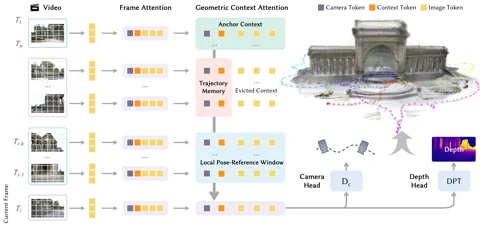

L’ingrediente segreto è un’architettura innovativa chiamata Geometric Context Transformer (GCT). Non si tratta dell’ennesimo transformer appiccicato a un problema di visione artificiale: il GCT è stato progettato specificamente per colpire il tallone d’Achille dei sistemi SLAM monoculari (a singola camera), ovvero il “drift” (la deriva dell’errore). Il sistema gestisce le informazioni geometriche attraverso tre meccanismi di attenzione paralleli: un contesto “anchor” per un ancoraggio stabile delle coordinate, una finestra di riferimento per le pose locali dedicata ai dettagli più minuti e una memoria della traiettoria per correggere gli errori sulle lunghe distanze. Questo permette a LingBot-Map di elaborare sequenze che superano i 10.000 frame con una precisione che Robbyant definisce “pressoché invariata”. Il progetto è già disponibile su GitHub. Link: Robbyant/lingbot-map

Le promesse sulle prestazioni sono, a dire il vero, audaci. Nel complesso dataset Oxford Spires, LingBot-Map ha registrato un errore di traiettoria assoluto di soli 6,42 metri, un miglioramento di quasi 2,8 volte rispetto al precedente miglior metodo di streaming. Supera persino i consolidati metodi offline, che hanno il lusso di poter elaborare tutte le immagini contemporaneamente. Sul benchmark ETH3D, ha ottenuto un punteggio F1 di 98,98, polverizzando il secondo classificato con un distacco di oltre 21 punti percentuali. Per chi volesse addentrarsi nei dettagli tecnici più crudi, l’intera metodologia è illustrata in un paper su arXiv. Link: Leggi il paper su arXiv

Perché è un passo avanti fondamentale?

LingBot-Map rappresenta una tappa cruciale verso la democratizzazione dell’intelligenza spaziale. Eliminando la necessità di costosi sensori LiDAR o di complessi sistemi multi-camera, apre le porte a una percezione 3D economica ma ad alte prestazioni per la robotica, i veicoli autonomi e la realtà aumentata. Non si tratta solo di creare nuvole di punti esteticamente gradevoli; si tratta di dare alle macchine una comprensione continua e in tempo reale del mondo fisico. Come “3D foundation model”, si inserisce nel trend più ampio di costruire un’IA che non si limiti a elaborare testi o immagini, ma che sia in grado di percepire, navigare e interagire con ambienti complessi e non strutturati: la pietra angolare per il futuro della embodied AI.