NVIDIA ने स्वायत्त ड्राइविंग (autonomous driving) की रेस में एक बड़ा धमाका करते हुए 5 जनवरी, 2026 को Alpamayo की घोषणा कर दी है। यह सिर्फ रास्ता देखने वाला कोई साधारण परसेप्शन मॉडल नहीं है; बल्कि यह एक ऐसा ओपन इकोसिस्टम है जिसे स्वायत्त वाहनों (AVs) को वह ताकत देने के लिए डिजाइन किया गया है जिसकी उनमें अब तक भारी कमी थी: यानी ‘तर्क’ करने और अपनी हर हरकत की वजह बताने की क्षमता। CEO Jensen Huang ने इसे “फिजिकल AI के लिए ChatGPT मोमेंट” करार दिया है, जिसका मकसद कारों को उन दुर्लभ या बिल्कुल नई परिस्थितियों में भी सूझ-बूझ से काम लेने में मदद करना है, जो पहले कभी उनके सामने न आई हों।

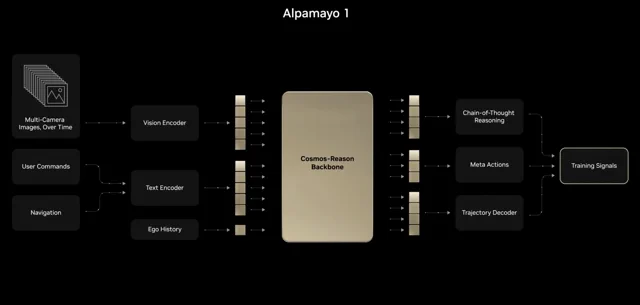

इसका पहला वर्जन, Alpamayo 1, एक बेहद शक्तिशाली विजन-लैंग्वेज-एक्शन मॉडल (VLAM) है। आसान भाषा में कहें तो, यह कार जो ‘देखती’ है, उसे भाषाई समझ के साथ जोड़कर यह तय करता है कि उसे क्या ‘करना’ है। इसकी सबसे बड़ी खूबी “एक्सप्लिसिट रीजनिंग ट्रेसेस” (explicit reasoning traces) जेनरेट करना है। इसका मतलब यह है कि अगर कार किसी आवारा शॉपिंग कार्ट से बचने के लिए अचानक मुड़ती है, तो वह आपको साफ-साफ बता पाएगी कि उसने ऐसा क्यों किया। इस AI को ट्रेन करने के लिए NVIDIA अपना Physical AI dataset भी रिलीज कर रहा है, जो 2,500 से अधिक शहरों के 3,00,000 से ज्यादा रियल-वर्ल्ड ड्राइविंग क्लिप्स का एक विशाल संग्रह है।

आखिर यह इतना अहम क्यों है?

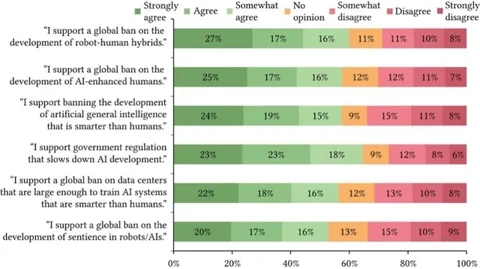

सालों से सेल्फ-ड्राइविंग इंडस्ट्री जनता के बीच विश्वास पैदा करने की जद्दोजहद में लगी है। ऐसे मॉडल्स जो किसी ‘ब्लैक बॉक्स’ की तरह काम करते हैं और अपनी निर्णय प्रक्रिया नहीं समझा पाते, लोगों में भरोसा नहीं जगा पाते। ‘एक्सप्लेनेबल AI’ (XAI) को बढ़ावा देकर NVIDIA सीधे तौर पर इसी भरोसे की कमी को दूर करने की कोशिश कर रहा है। तर्क-आधारित (reasoning-driven) मॉडल्स की ओर यह कदम लेवल 3 की बाधाओं को पार कर सच्चे लेवल 4 स्वायत्त ड्राइविंग तक पहुंचने के लिए एक अनिवार्य शर्त है। लेवल 4 का मतलब है ऐसी ड्राइविंग जहां वाहन बिना किसी मानवीय हस्तक्षेप के लगभग हर स्थिति को खुद संभाल सके। अब बात सिर्फ सड़क को ‘देखने’ की नहीं, बल्कि उसे असल मायने में ‘समझने’ की है।