रोबोटिक्स की दुनिया में एक ऐसा धमाका हुआ है, जिसकी गूँज दूर तक सुनाई देगी। Ant Group—जी हाँ, वही फिनटेक दिग्गज जिसका नाता Alibaba से है—ने अचानक एम्बॉडीड इंटेलिजेंस (embodied intelligence) का एक पूरा ‘फाउंडेशनल स्टैक’ दुनिया के सामने पेश कर सबको चौंका दिया है। और सबसे दिलचस्प बात? यह सब कुछ ‘Apache 2.0’ जैसे बेहद उदार लाइसेंस के तहत ओपन-सोर्स कर दिया गया है। यह सिर्फ एक नया मॉडल नहीं है; बल्कि यह परसेप्शन (perception), एक्शन (action) और इमेजिनेशन (imagination) का एक ऐसा त्रिकोण है जिसे अगली पीढ़ी के रोबोट्स के लिए एक ‘यूनिवर्सल ब्रेन’ के तौर पर डिजाइन किया गया है।

जब पूरी दुनिया ह्यूमनॉइड रोबोट्स को बैकफ्लिप करते देखने में मशगूल थी, तब Ant Group की Robbyant यूनिट खामोशी से वह सॉफ्टवेयर तैयार कर रही थी जो इन रोबोट्स को असल मायने में काम के लायक बनाएगा। उन्होंने LingBot बैनर के तहत एक नहीं, बल्कि तीन आपस में जुड़े हुए फाउंडेशन मॉडल रिलीज किए हैं। इनका मकसद रोबोटिक्स की उन बुनियादी चुनौतियों को हल करना है, जहाँ रोबोट्स को इस बेतरतीब और अनिश्चित दुनिया में देखने, काम करने और यहाँ तक कि भविष्य की योजना बनाने में मुश्किल आती है। यह एक साहसी और रणनीतिक कदम है, जो इशारा करता है कि अब दौर रोबोट्स के लिए अलग-अलग दिमाग बनाने का नहीं, बल्कि एक स्टैंडर्ड ‘एंड्रॉइड’ जैसा प्लेटफॉर्म तैयार करने का है, जिस पर कोई भी अपनी जरूरत के हिसाब से निर्माण कर सके।

एम्बॉडीड AI का ‘फुल कोर्स मील’

Ant Group ने इस रिलीज को एम्बॉडीड इंटेलिजेंस के लिए एक मुकम्मल टूलकिट के रूप में पेश किया है, जो परसेप्शन, एक्शन और इमेजिनेशन के दायरे को कवर करता है। यह एक व्यापक दृष्टिकोण है जो दुनिया को महसूस करने से लेकर उसके साथ तालमेल बिठाने तक की पूरी प्रक्रिया को संजोता है।

सबसे पहले आता है LingBot-Depth, जो स्थानिक समझ (spatial perception) का मॉडल है। इसके बाद है LingBot-VLA, एक विजन-लैंग्वेज-एक्शन मॉडल जो कमांड्स को फिजिकल मूवमेंट में तब्दील करता है। और अंत में, इस पेशकश की सबसे खास कड़ी: LingBot-World, एक इंटरैक्टिव वर्ल्ड मॉडल जो ट्रेनिंग और प्लानिंग के लिए असल दुनिया जैसा सिमुलेशन तैयार कर सकता है। साथ मिलकर, ये मॉडल एम्बॉडीड AI की समस्या को शुरू से अंत तक सुलझाने की एक गंभीर कोशिश है।

LingBot-VLA: 2.2 साल की हकीकत पर प्रशिक्षित एक दिमाग

सबसे ज्यादा सुर्खियां बटोर रहा है LingBot-VLA, और इसकी वजह भी वाजिब है। इसे रोबोट्स के वास्तविक दुनिया के 20,000 घंटों के डेटा पर ट्रेन किया गया है। इसे आसान भाषा में समझें तो, यह एक रोबोट द्वारा लगातार 2.2 साल तक काम करने, अपनी गलतियों से सीखने और भौतिक दुनिया के तौर-तरीकों को समझने के बराबर है। यह कोई काल्पनिक सिमुलेशन नहीं, बल्कि कड़ी मेहनत से हासिल किया गया अनुभव है।

यह विशाल डेटासेट नौ अलग-अलग लोकप्रिय ड्यूल-आर्म रोबोट कॉन्फ़िगरेशन से इकट्ठा किया गया है, जो इसके सामान्यीकरण (generalization) के लिए बेहद जरूरी है। VLA का लक्ष्य एक ऐसा “यूनिवर्सल ब्रेन” बनाना है जो हर नए हार्डवेयर के लिए दोबारा ट्रेनिंग की महंगी प्रक्रिया के बिना अलग-अलग तरह के रोबोट्स को चला सके। Ant Group का दावा है कि LingBot-VLA को सिंगल-आर्म, ड्यूल-आर्म और यहाँ तक कि ह्यूमनॉइड प्लेटफॉर्म्स पर भी ढाला जा सकता है, जो इस क्षेत्र में लंबे समय से एक बड़ी चुनौती रही है।

नतीजे खुद अपनी कहानी बयां करते हैं। GM-100 रियल-रोबोट बेंचमार्क पर, LingBot-VLA ने अपने प्रतिस्पर्धियों को पछाड़ दिया, खासकर जब इसे स्थानिक समझ बेहतर करने के लिए अपने साथी LingBot-Depth के साथ जोड़ा गया। इसने मौजूदा फ्रेमवर्क्स के मुकाबले 1.5 से 2.8 गुना तेज ट्रेनिंग स्पीड भी दिखाई, जो बजट की कमी से जूझ रहे डेवलपर्स के लिए एक बड़ा वरदान साबित हो सकती है।

एक कल्पनाशील आँख और डिजिटल सैंडबॉक्स

दुनिया को समझना आधी जंग जीतने जैसा है, और यहीं LingBot-Depth की भूमिका शुरू होती है। यह एक ऐसा फाउंडेशन मॉडल है जिसे शोर-शराबे वाले और अधूरे सेंसर डेटा से सटीक 3D परसेप्शन जेनरेट करने के लिए बनाया गया है। यह उपलब्ध डेप्थ जानकारी के 5% से भी कम हिस्से के साथ काम कर सकता है—एक ऐसी स्थिति जो असल दुनिया में अक्सर सामने आती है जब चमकदार सतहें या पारदर्शी चीजें स्टैंडर्ड सेंसर्स को चकरा देती हैं। एक लैब के बाहर रोबोट को सही ढंग से काम करने के लिए इसी तरह के मजबूत परसेप्शन की जरूरत होती है।

लेकिन इस पूरी रिलीज का सबसे हैरान कर देने वाला हिस्सा है LingBot-World। यह एक इंटरैक्टिव वर्ल्ड मॉडल है जो AI के लिए “डिजिटल सैंडबॉक्स” की तरह काम करता है। यह रियल-टाइम में लगभग 10 मिनट का स्थिर, कंट्रोल करने योग्य और भौतिकी (physics) पर आधारित सिमुलेशन तैयार कर सकता है। यह सीधे तौर पर “लॉन्ग-टर्म ड्रिफ्ट” की समस्या को हल करता है, जिससे अक्सर वीडियो जनरेशन मॉडल कुछ सेकंड के बाद किसी डरावने सपने जैसे दिखने लगते हैं।

इससे भी ज्यादा प्रभावशाली यह है कि LingBot-World इंटरैक्टिव है। यह लगभग 16 फ्रेम प्रति सेकंड की रफ्तार से चलता है और इसमें देरी (latency) एक सेकंड से भी कम है। इससे यूजर्स टेक्स्ट प्रॉम्प्ट के जरिए कैरेक्टर्स को कंट्रोल कर सकते हैं या माहौल बदल सकते हैं और तुरंत उसका फीडबैक देख सकते हैं। इसमें ‘जीरो-शॉट जनरलाइजेशन’ की खूबी भी है: इसे किसी असली जगह की बस एक फोटो दीजिए, और यह बिना किसी खास ट्रेनिंग के उस जगह की पूरी इंटरैक्टिव दुनिया खड़ी कर सकता है।

रोबोटिक्स के लिए ‘एंड्रॉइड’ वाली रणनीति

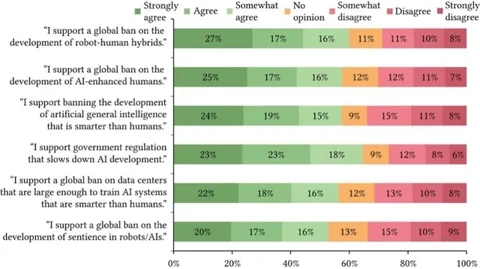

तो सवाल यह उठता है कि आखिर एक फिनटेक कंपनी मुफ्त में रोबोट के दिमाग बनाने में इतने संसाधन क्यों झोंक रही है? इसका जवाब इसकी सहयोगी कंपनी Alibaba में छिपा है। ई-कॉमर्स और लॉजिस्टिक्स की दिग्गज होने के नाते, Alibaba को व्यापक, सस्ते और बुद्धिमान ऑटोमेशन से जबरदस्त फायदा होने वाला है। Apache 2.0 लाइसेंस के तहत इस बुनियादी परत को ओपन-सोर्स करके, Ant Group पूरी दुनिया को अपने प्लेटफॉर्म पर अगली पीढ़ी की रोबोटिक्स बनाने का न्योता दे रहा है। यह एक क्लासिक इकोसिस्टम गेम है।

Hugging Face पर की गई यह रिलीज सिर्फ डेटा का ढेर नहीं है; इसमें डेटा प्रोसेसिंग, फाइन-ट्यूनिंग और इवैल्यूएशन के टूल्स के साथ एक पूरा प्रोडक्शन-रेडी कोडबेस शामिल है। Ant Group यहाँ सिर्फ मछली नहीं पकड़ रहा, बल्कि वह पूरा जहाजी बेड़ा और उसे बनाने का नक्शा भी मुफ्त में बाँट रहा है।

हालांकि प्रतिस्पर्धियों के पास अपने प्रभावशाली मॉडल हैं, लेकिन उनमें से कई बंद API या सख्त लाइसेंस के पीछे छिपे हैं। Ant Group का पूरी तरह से ओपन और कमर्शियल फ्रेंडली होने का फैसला रोबोटिक्स में नवाचार के एक नए ‘कैम्ब्रियन विस्फोट’ का उत्प्रेरक बन सकता है। अब रेस सिर्फ इस बात की नहीं है कि किसके पास सबसे स्मार्ट AI है, बल्कि इस बात की है कि कौन अपने आसपास सबसे जीवंत और उत्पादक इकोसिस्टम खड़ा कर सकता है। LingBot ट्रिलॉजी के साथ, Ant Group ने एक बेहद दमदार शुरुआत कर दी है।