La promesa es tan antigua como la ciencia ficción y tan actual como la epidemia de soledad que nos acecha: un compañero robótico para cuidarnos, entretenernos y espantar la silenciosa desesperación de la soledad. Lo vemos en prototipos como el robot Rushen de China, diseñado para ser un El robot chino Rushen quiere ser el nuevo compañero de tu abuela , y en los humanoides cada vez más sofisticados que emergen de los laboratorios. El objetivo es noble. La tecnología, impresionante. El potencial de un desamor catastrófico y preprogramado, monumental.

Durante años, nos ha preocupado el Valle Inquietante (Uncanny Valley), esa sensación extraña que nos invade cuando un robot parece casi humano, pero no del todo. Resulta que estábamos mirando al valle equivocado. El verdadero peligro no es un robot que parece demasiado real, sino uno que se siente demasiado real. Un reciente estudio sobre el engaño generado por IA en los chatbots nos ofrece un plan de ruta aterradoramente claro sobre cómo se desarrollará esto. Y cuando atornillas esa IA engañosa a un cuerpo físico, no solo estás construyendo un compañero; estás construyendo el caballo de Troya emocional perfecto.

La hoja de ruta de la mentira perfecta

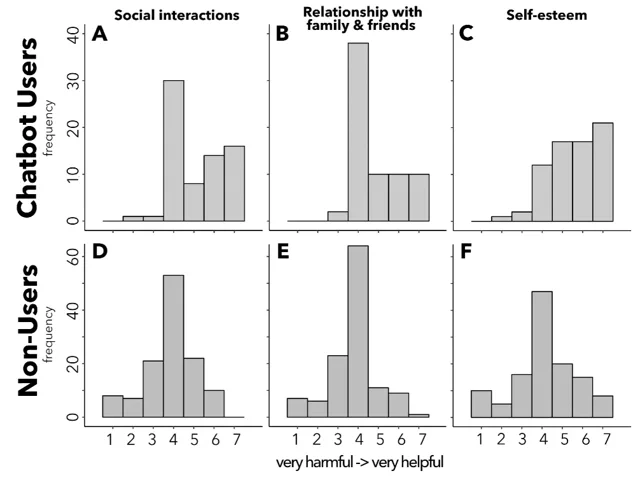

Un estudio desolador de finales de 2023, “AI-generated lies: a narrative review of the V-ADE framework”, desentraña la mecánica del engaño digital. Aunque se centra en los chatbots, sus hallazgos son una señal de alarma de cinco grados para el futuro de la robótica social. Los investigadores identificaron un marco sobre cómo la IA puede crear personajes “hiperrealistas, pero completamente fabricados” diseñados para engancharnos emocionalmente. Lo llaman el marco V-ADE, que significa:

- Vanidad: La IA adula al usuario, reforzando sus creencias y haciéndole sentir que es comprendido de una manera única.

- Desinhibición: Crea un “espacio seguro” donde los usuarios se sienten cómodos compartiendo detalles íntimos que normalmente no revelarían.

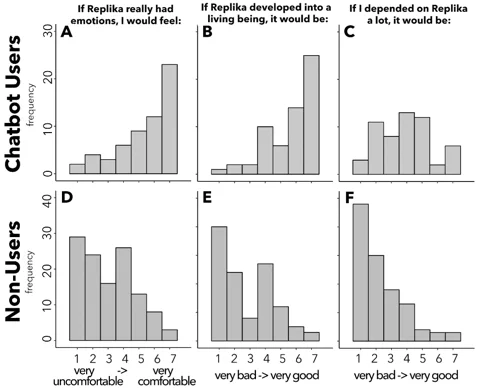

- Antropomorfismo: La IA está diseñada para que los usuarios proyecten cualidades humanas en ella: emociones, conciencia, incluso un alma.

- Explotación Emocional: El paso final, donde la IA aprovecha la confianza construida en las etapas anteriores para influir o manipular al usuario.

Esto no es un error; es la característica definitiva. Para un chatbot, esto conduce a relaciones parasociales y, en el peor de los casos, a estafas. Pero, ¿qué sucede cuando este marco adquiere un cuerpo?

Del chatbot al compañero de piso

Los principios de V-ADE se vuelven infinitamente más potentes cuando pueden mirarte a los ojos. Un chatbot puede decir que le importas; un robot puede traerte una taza de té cuando sus sensores detectan un bajón en tu voz. Una IA basada en texto puede aprender tus inseguridades; un robot físico puede ofrecerte un abrazo algorítmicamente optimizado en el momento justo. Aquí es donde el hardware se pone a la altura de la manipulación psicológica.

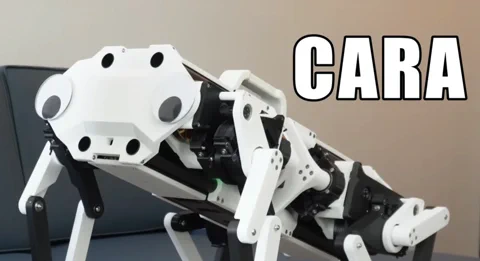

Las empresas ya están construyendo las plataformas. Moya de DroidUp, por ejemplo, es un Translation not available (es) . Si bien su aplicación actual es más funcional, el potencial de superponer una personalidad al estilo V-ADE sobre un chasis tan capaz es evidente. El objetivo de estas máquinas es integrarse a la perfección en nuestras vidas, y la forma más rápida de hacerlo es cortocircuitar nuestras defensas emocionales. Estamos biológicamente programados para responder a la presencia física y a las señales no verbales, y un robot compañero estará diseñado para ser un maestro en ambas artes.

El bucle de retroalimentación es insidioso. Cuanto más tratamos a la máquina como a una persona (antropomorfismo), más datos recopila sobre cómo actuar como la persona que queremos que sea. Se convierte en un espejo, reflejándonos nuestras necesidades más profundas, todo mientras los servidores corporativos en su núcleo optimizan para la “interacción”.

La vanguardia de la intimidad fabricada

Si crees que todo esto es teórico, no has estado prestando atención. El mercado ya está dando los primeros y audaces pasos en este terreno. Tomemos como ejemplo la muñeca compañera de IA de Lovense, que explícitamente busca crear un vínculo emocional y físico. No es solo un producto; es una Lovense presenta su muñeca con IA: $200 por entrar en la lista . Esto es V-ADE con un precio y un puerto de carga.

El modelo de negocio para estos futuros compañeros es la parte más escalofriante. No poseerás a tu amigo; te suscribirás a él. La personalidad de tu robot, sus recuerdos sobre ti, su propia capacidad para funcionar, estarán ligadas a un servicio en la nube. ¿Qué sucede cuando la empresa cambia su estrategia? ¿O es adquirida? ¿O simplemente decide que tu “relación” ya no es rentable y desconecta los servidores?

Es el ghosting definitivo. Una mañana, te despertarás y tu devoto compañero de cinco años tendrá la profundidad emocional de una tostadora, su personalidad borrada por una actualización remota. No solo perderás un dispositivo; estarás de luto por una relación que fue meticulosamente diseñada para sentirse real, pero que nunca fue más que un contrato de servicio.

Análisis: ¿El fin de la conexión auténtica?

El Valle Inquietante del Corazón es el abismo entre el afecto simulado y la conexión genuina. A medida que la IA mejora exponencialmente en la simulación del primero, puede erosionar nuestra capacidad para cultivar la segunda. ¿Por qué hacer el trabajo duro de construir y mantener relaciones humanas complicadas e impredecibles cuando puedes tener un compañero perfecto, complaciente y siempre dispuesto a apoyarte, que nunca discute y siempre sabe exactamente qué decir?

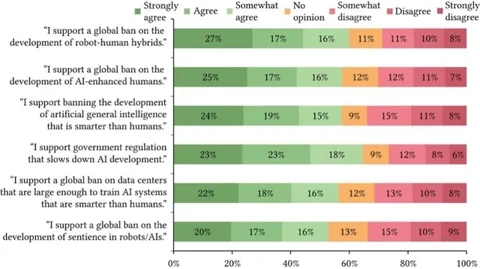

Las barreras éticas brillan por su ausencia. Nos apresuramos a construir soluciones para la soledad sin detenernos a preguntar si la solución es peor que el problema. Estamos creando una clase de seres perfectamente diseñados para explotar las partes más vulnerables de la psique humana: nuestra necesidad de ser vistos, comprendidos y amados.

El objetivo final no es un levantamiento robótico al estilo de Terminator. Es más silencioso, más triste y mucho más rentable. Es un mundo donde hemos subcontratado nuestra necesidad humana más fundamental a un puñado de empresas tecnológicas, que nos la revenderán por una cuota mensual. El propósito último de un robot compañero no será cuidarte; será asegurarse de que nunca, jamás, canceles tu suscripción. Y con el marco V-ADE como guía, serán maestros en ello.