Año 2035. Imagina la escena: te encuentras supervisando una planta de fabricación que bulle con 300 robots humanoides, cada uno ejecutando sus tareas en un silencio eficiente, casi poético. Pero aquí viene el quid de la cuestión, el pequeño gran detalle que te quita el sueño: tienes 300 mandos a distancia, uno por cada autómata. Y sí, tus intentos de construir un traje mecha gigante con ellos ya te han valido varias advertencias de Recursos Humanos. La logística pura y dura de gestionar una plantilla robótica tan vasta es, sin duda, uno de los escollos más grandes –y menos glamurosos– en nuestro camino hacia un futuro totalmente automatizado. ¿Y si pudieras, simplemente… pensar, y que tus robots obedecieran?

Esto no es el arranque de un thriller de ciencia ficción; es el problema que un nuevo proyecto de código abierto, llamado Kinexus, se ha propuesto resolver. En un mundo que avanza a zancadas hacia interfaces cerebro-ordenador (BCI) invasivas como Neuralink, Kinexus adopta un enfoque más terrenal: utiliza un auricular EEG no invasivo para traducir los pensamientos y comandos vocales de un usuario en acciones para toda una flota de robots humanoides. Aquí hay menos bisturí y más ingeniería práctica: un puente escalable entre la mente humana y una fuerza de trabajo robótica.

La crisis de escalabilidad en el control robótico

A medida que las fábricas y almacenes se lanzan a desplegar robots humanoides, se enfrentan a un desafío operativo colosal. El modelo uno a uno, un operador por cada robot, simplemente no escala. Los métodos de control actuales a menudo implican interfaces de software complejas o los engorrosos “pendientes de enseñanza” que exigen una programación directa e individualizada. Esto genera un cuello de botella que limita la eficiencia que, paradójicamente, los robots deberían aportar. Gestionar un puñado de robots ya es complejo; gestionar cientos es una pesadilla logística.

Aquí es donde el concepto de un centro de mando centralizado e intuitivo se vuelve crítico. La industria necesita un “plano de control” para sus activos físicos, una forma en que un único supervisor humano pueda orquestar toda una flota sin fisuras. Kinexus propone que la interfaz de usuario más intuitiva es la que traemos de serie: nuestro cerebro.

Kinexus: tu cerebro es el nuevo salpicadero

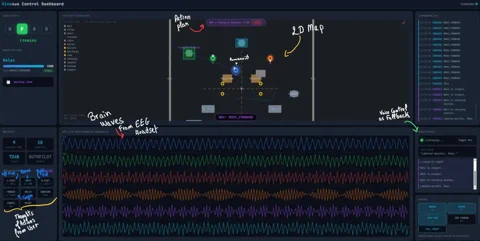

En su esencia, Kinexus es un panel de control que actúa como intérprete en tiempo real entre tú y tu ejército de robots. Desarrollado por el ingeniero de IA Mourad Ouazmour, el sistema, escrito principalmente en Python, está diseñado para ser el sistema nervioso central de la automatización industrial. Visualiza las señales cerebrales entrantes de un auricular EEG comercial, las traduce en comandos discretos y mapea todo el entorno de la fábrica para una conciencia situacional total.

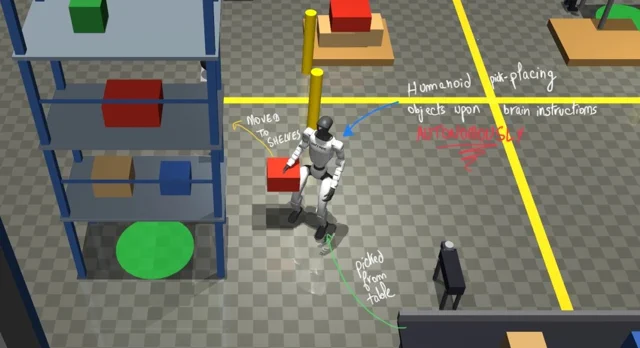

El esquema de control es sorprendentemente directo. Según detalla su desarrollador, un usuario podría cerrar el puño derecho para que un robot gire a la derecha, cerrar ambos para que avance, o incluso tocar su lengua para cambiar de modo. El panel de control lo muestra en acción:

- Forma de onda EEG en vivo: Una transmisión en tiempo real de la actividad eléctrica de tu cerebro, separada en diferentes canales.

- Panel de métodos: Este es el motor de traducción, donde las señales mentales específicas (como imaginar que cierras un puño) se mapean a acciones robóticas como “MOVE_LEFT” o “MOVE_FORWARD”.

- Mapa de la planta de la fábrica: Un esquema 2D que muestra la ubicación de cada humanoide, su estado y su plan de acción actual.

- Fallback de voz: Para tareas autónomas más complejas, el sistema evita la telepatía directa. Un usuario puede simplemente decir: “recoge la caja de la cinta transportadora y colócala en el Pallet 2”, y el humanoide designado navegará y ejecutará de forma autónoma toda la secuencia.

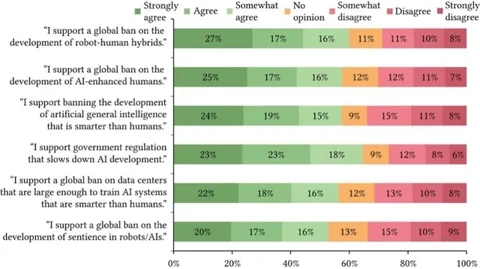

La ambición de la ciencia ficción choca con la realidad del código abierto

Aunque controlar robots con EEG no invasivo no es una novedad absoluta, su aplicación en este contexto —la gestión de flotas— es lo que convierte a Kinexus en una propuesta tan atractiva. La investigación en control basado en EEG a menudo se ha centrado en asistir a personas con discapacidades o en el control de un solo robot, con tasas de precisión para tareas simples que oscilan entre el 70% y más del 90% según el método. Kinexus aspira a sacar esta tecnología del laboratorio y llevarla directamente a la cadena de montaje.

La decisión de hacer de Kinexus un proyecto de código abierto en GitHub es su característica más significativa. Democratiza el acceso a este paradigma de control avanzado. No es un producto de “jardín vallado” de un gigante de la robótica, sino un kit de herramientas disponible para que cualquiera experimente con él, lo desarrolle o lo integre con hardware como la plataforma de código abierto OpenBCI. Esto invita a una comunidad de desarrolladores a abordar los desafíos inherentes al control EEG, como el ruido de la señal y la necesidad de calibración específica para cada usuario.

Por supuesto, el camino desde un repositorio de GitHub hasta una fábrica bulliciosa y controlada por la mente es largo. El EEG no invasivo tiene una resolución más baja que los métodos invasivos, y lograr la fiabilidad del 99%+ requerida para aplicaciones industriales es una tarea hercúlea. Pero Kinexus no vende un producto acabado; presenta una idea potente y audaz. Sugiere un futuro donde la supervisión humana en entornos automatizados sea menos un frenético tecleo de botones y más una intención estratégica y concentrada. Por ahora, es un fascinante atisbo de un futuro donde gestionar cientos de robots podría ser tan fácil como un pensamiento fugaz.