El 18 de diciembre de 2025, Google lanzó discretamente FunctionGemma, un minúsculo modelo de IA de 270 millones de parámetros, diseñado para funcionar íntegramente en el propio dispositivo. La nota de prensa se centró en los teléfonos inteligentes: establecer recordatorios, encender linternas, las tareas habituales de un asistente digital. Lo de siempre, vamos. Pero, oculta entre esas especificaciones, se esconde algo mucho más fascinante: la hoja de ruta para abaratar drásticamente la robótica.

Aquí va el secreto a voces de los robots “inteligentes” actuales: la mayoría no son inteligentes en absoluto. Son meros terminales. La inteligencia reside en algún centro de datos a miles de kilómetros, conectados por un enlace a internet que añade latencia, cuesta dinero y falla en cuanto te adentras en una zona sin cobertura. Cada vez que tu robot de almacén necesita tomar una decisión, está “llamando a casa” como un adolescente inseguro pidiendo permiso.

FunctionGemma cambia por completo la ecuación.

Las cifras que realmente importan

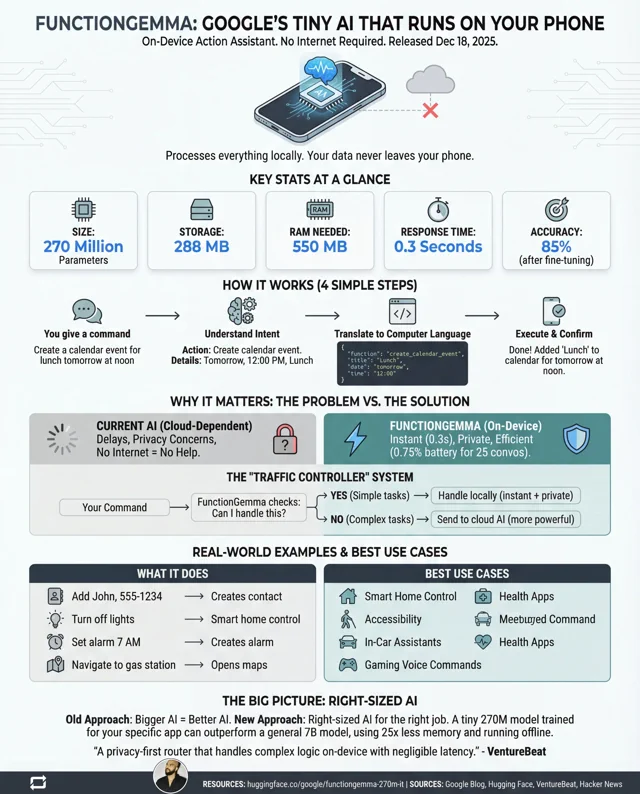

Dejemos a un lado la retórica de marketing y centrémonos en lo que realmente importa para la robótica:

- 288 MB storage footprint – Cabe en los microcontroladores más económicos

- 550 MB RAM – Una Raspberry Pi 4 tiene 8 GB de sobra

- 0.3 second response time – En el dispositivo, sin viajes de ida y vuelta por la red

- 58% accuracy baseline → 85% after fine-tuning – Entrenable para tareas específicas

Este último punto es clave. FunctionGemma no está diseñado para ser un chatbot de uso general. Está pensado para ser ajustado (fine-tuned) a tareas concretas y específicas, exactamente lo que hacen los robots. Un robot de almacén no necesita debatir sobre filosofía. Necesita entender “recoger caja A, mover a estante B” y ejecutarlo a la perfección, miles de veces al día.

Por qué los robots dependientes de la nube son un callejón sin salida

El paradigma actual de los robots “inteligentes” está roto de raíz. Imaginemos qué ocurre cuando tu robot necesita tomar una decisión:

- Datos del sensor capturados

- Datos comprimidos y enviados a la nube

- Servidor en la nube procesa la solicitud

- Respuesta enviada de vuelta

- El robot actúa

Son cinco pasos con múltiples puntos de fallo. ¿Congestión de red? El robot se congela. ¿Servidor sobrecargado? El robot espera. ¿Corte de internet? El robot se convierte en un pisapapeles muy caro. Y tú estás pagando por cada milisegundo de tiempo de cómputo y cada megabyte de transferencia de datos.

Para una aspiradora doméstica, esto podría ser tolerable. ¿Pero para una flota de 500 robots de almacén funcionando 24/7? Las facturas de la nube por sí solas podrían llevarte a la bancarrota, y la latencia hace que la coordinación en tiempo real sea prácticamente imposible.

La revolución del Edge Computing llega a la robótica

FunctionGemma representa un cambio de paradigma filosófico: en lugar de preguntarse “¿cómo hacemos los robots lo suficientemente inteligentes como para necesitar la nube?”, Google se pregunta “¿cómo hacemos la nube lo suficientemente pequeña como para caber en un robot?”.

Esto no es algo insólito. La industria automotriz lo entendió hace años: el frenado de emergencia automático de tu coche no “llama a Google” antes de decidirse a parar. La decisión se toma localmente, en milisegundos, porque la latencia mata (literalmente). Pero hasta ahora, los modelos de IA capaces de comprender comandos en lenguaje natural y traducirlos en acciones eran demasiado masivos para su despliegue en el edge.

Cómo luce la robótica barata

Imagina un robot asistente doméstico de 200 $ con:

- Comprensión total del lenguaje natural para comandos comunes

- Sin cuotas de suscripción mensuales

- Funciona a la perfección durante los cortes de internet

- Tus datos de voz nunca abandonan el dispositivo

- Respuesta instantánea a los comandos

O visualiza robots agrícolas que pueden operar en campos sin cobertura celular. Drones de respuesta a desastres que no necesitan Starlink para funcionar. Compañeros para el cuidado de ancianos que no requieren una suscripción a la nube para recordar a alguien que tome su medicación.

El ahorro de costes se multiplica a todos los niveles. Hardware de cómputo más barato significa robots más económicos. Sin dependencia de la nube, no hay cuotas recurrentes. Procesamiento local significa requisitos de red más sencillos. Privacidad por diseño significa una aprobación regulatoria más sencilla.

La arquitectura de “controlador de tráfico”

Google no es tan ingenuo como para afirmar que FunctionGemma puede reemplazar por completo a los grandes modelos de lenguaje (LLMs). Su arquitectura propuesta es más inteligente: utilizar FunctionGemma como un “controlador de tráfico” local que gestiona el 90% de los comandos sencillos de inmediato, y solo redirige las consultas complejas a la nube cuando es necesario.

Para un robot, esto podría verse así:

- Gestionado localmente: “Mover hacia adelante”, “Detener”, “Recoger el objeto rojo”, “Volver a la estación de carga”

- Enviado a la nube: “Analiza este objeto inusual y dime qué es”, “Planifica una ruta óptima a través de este nuevo entorno”

Este enfoque híbrido ofrece la velocidad y fiabilidad del edge computing para operaciones rutinarias, al tiempo que mantiene el acceso a la inteligencia a escala de la nube para casos realmente excepcionales.

El factor del fine-tuning

Quizás el aspecto más importante para la robótica es la capacidad de entrenamiento (trainability) de FunctionGemma. La precisión inicial del 58% suena terrible, y lo es, para un asistente de uso general. Pero ajustado (fine-tuned) a un vocabulario específico de comandos y acciones de robot, salta al 85%.

Ahora, imagina qué ocurre cuando una empresa de robótica lo ajusta específicamente para su caso de uso:

- Robot recolector de almacén: 50 comandos esenciales, vocabulario optimizado, precisión potencialmente superior al 95%

- Dron de reparto: comandos de navegación, anulaciones de seguridad, respuestas meteorológicas

- Brazo de fabricación: instrucciones de movimiento precisas, controles de calidad

Cada tipo de robot obtiene un cerebro de IA a medida, perfectamente dimensionado para sus necesidades y entrenado con el vocabulario exacto que encontrará. Esto es lo opuesto al enfoque de “un modelo gigante para gobernarlos a todos”: es modular, eficiente y desplegable.

Las implicaciones para los fabricantes de robots

Para las empresas que construyen robots, FunctionGemma representa un punto de inflexión estratégico:

Cambios en la estructura de costes: La lista de materiales (bill of materials) para un robot “inteligente” podría reducirse en cientos de dólares al no necesitar hardware de red costoso ni redundancia de conectividad a la nube.

El modelo de suscripción muere: Robot-as-a-Service depende de la dependencia de la nube para retener a los clientes con pagos recurrentes. La IA local rompe ese modelo, y los clientes lo notarán.

La fiabilidad se vuelve alcanzable: Un robot que puede funcionar de forma autónoma significa un tiempo de actividad garantizado sin una infraestructura de red faraónica.

La privacidad se convierte en una característica: Los datos que nunca abandonan el dispositivo no pueden ser vulnerados, filtrados o requeridos judicialmente.

Lo que falta

No vendamos la moto todavía. FunctionGemma tiene limitaciones reales:

- Sin razonamiento multi-paso: “Recoge la caja, comprueba la etiqueta y ponla en el contenedor correcto” está actualmente más allá de sus capacidades.

- Los comandos indirectos presentan dificultades: “La habitación está demasiado iluminada” no activará un ajuste de luz.

- 15% de tasa de error: Aceptable para muchas aplicaciones, peligroso para otras.

Pero estos son problemas de software con soluciones conocidas. El razonamiento multi-paso es para lo que sirve el . Los comandos indirectos pueden manejarse mediante fine-tuning con paráfrasis. Las tasas de error disminuirán con conjuntos de datos de entrenamiento más grandes e iteraciones del modelo.

Las limitaciones de hardware: ese es el verdadero problema. Y Google acaba de demostrar que 270 millones de parámetros son suficientes para una invocación de funciones (function calling) práctica. Ese es el gran avance.

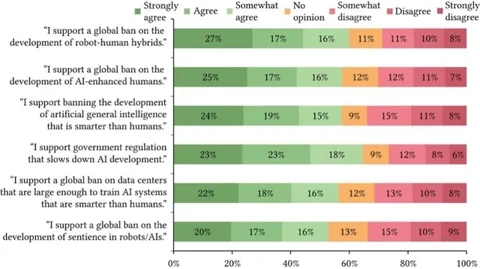

El panorama general

FunctionGemma no va a crear por sí solo la revolución robótica. Pero es una prueba de concepto que la industria de la IA necesitaba desesperadamente: no hace falta un modelo de un billón de parámetros para que las máquinas sean útiles. Necesitas el modelo del tamaño adecuado para el trabajo adecuado.

Las implicaciones se extienden más allá de la robótica, llegando al IoT, los wearables, los dispositivos médicos y cualquier otra cosa que necesite tomar decisiones sin “llamar a casa”. Pero, específicamente para la robótica, esto se siente como el momento que la industria ha estado esperando: el instante en que “robot inteligente” deja de significar “robot caro”.

El futuro de la robótica asequible no está en la nube. Está en 288 megabytes de pesos cuidadosamente entrenados, funcionando localmente, respondiendo al instante, trabajando en todas partes. Google nos acaba de dar un atisbo de cómo será. Ahora les toca a los fabricantes de robots construirlo.